Ale jeśli inteligentna kamera może wykryć wszelkie podejrzane działania i automatycznie uruchomić alarm, aby zadzwonić na policję, to takie akty przestępcze mogą być uniemożliwione.

Dowiedzmy się więc, jak zbudować takie urządzenie w tym projekcie.

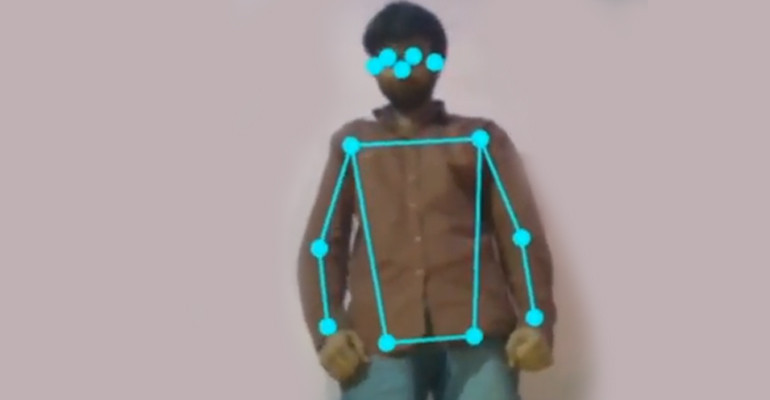

Nauczanie kamery

Najpierw stwórz model ML posiadający zestawy danych normalnych czynności, takich jak chodzenie, rozmowa, czytanie, siedzenie itp. Następnie wprowadź do modelu ML zbiory danych dotyczące podejrzanych działań, takich jak bójki, boksowanie, celowanie z broni lub inne gwałtowne ruchy uznane za podejrzane.

Wykonuj również takie czynności przed inteligentną kamerą, aby uchwycić różne ruchy. Będzie to przydatne do szkolenia modelu ML i wdrożenia go na Raspberry Pi, aby uczynić kamerę AI inteligentną.

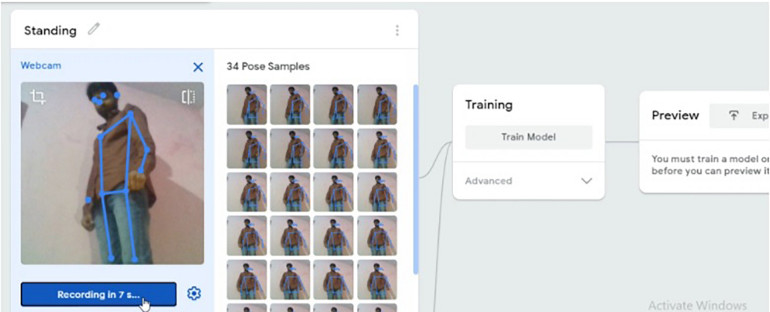

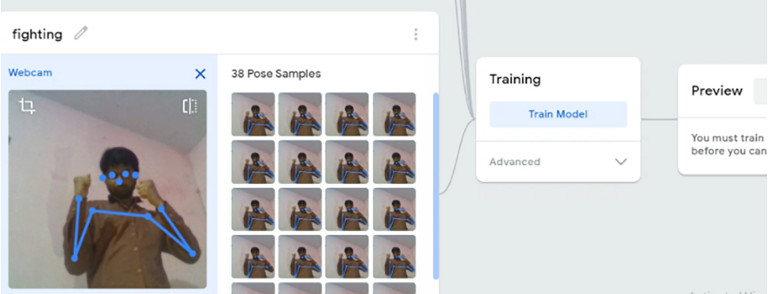

Aby utworzyć i wyszkolić model ML, istnieje kilka elastycznych opcji, takich jak TensorFlow, Google Teachable, Edge Impulse, Lobe itp. Można wybrać dowolną z nich i wykorzystać w poniższym projekcie. W naszym przypadku użyty został Google Teachable.

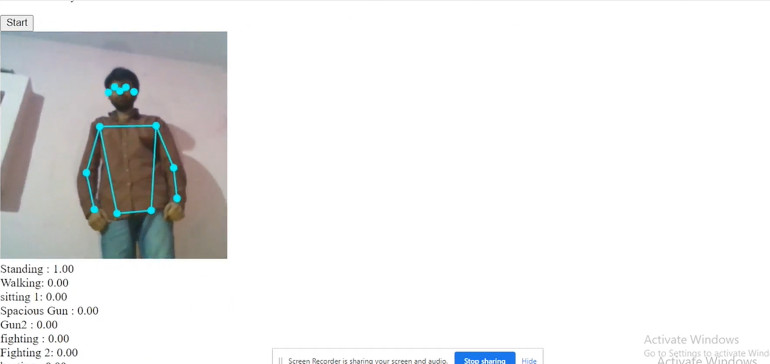

W Google Teachable, wybierz opcję PoseNet do śledzenia różnych ruchów ciała i działań. Wcześniej wykonywaliśmy różne czynności, takie jak chodzenie, mówienie, jedzenie, stanie itp. Poprawnie oznacz je i wprowadź te zbiory danych do modelu ML. Podobnie, podaj zbiory danych o czynnościach takich jak celowanie z broni, strzelanie z broni, walka, bicie itp.

Po wprowadzeniu wymaganych zbiorów danych, kliknij na „Train Model”. Pojawi się opcja wyeksportowania modelu ML lub przesłania go do chmury. Prześlij model ML do chmury, ponieważ będzie on tam bezpiecznie przechowywany, co pozwoli użytkownikom na dostęp i wdrożenie go w dowolnym miejscu na świecie.

Po przesłaniu modelu do chmury otrzymasz adres URL, pod którym możesz go używać.

Wdrażanie na kamerze

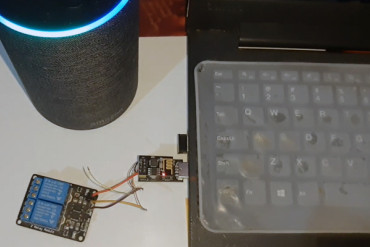

Następnie wdrażamy model ML na kamerze i podłączamy głośnik, aby Raspberry Pi uruchamiało alarm w przypadku wykrycia podejrzanej aktywności.

Kodowanie

W tym kroku należy wdrożyć model ML w Raspberry Pi, do czego wymagane jest napisanie kodu.

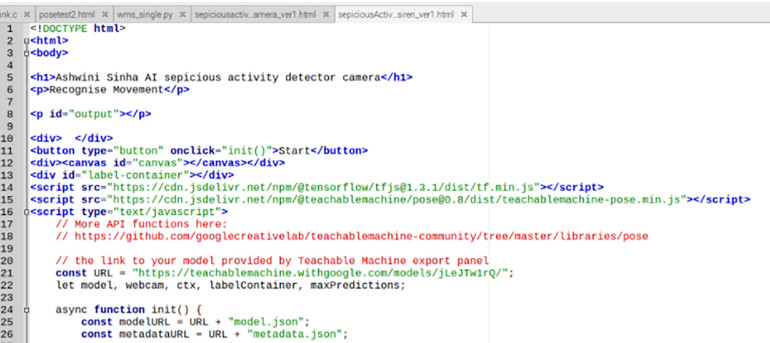

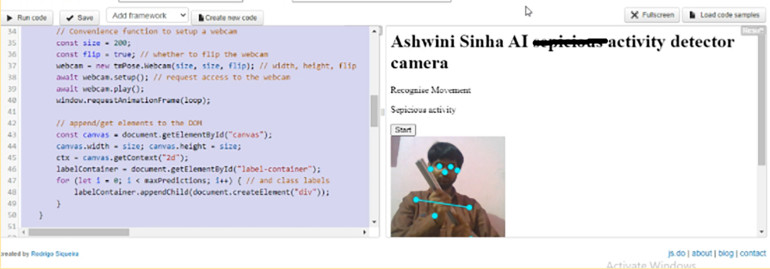

W czasie wgrywania modelu ML, otrzymamy przykładowy fragment kodu. Skopiuj go i wklej do swojego kodu JavaScript (JS). Kodowanie i testowanie JS może być wykonane za pomocą dowolnego edytora kodu, offline lub online. Można również nadać w HTML nazwę kamerze dla modelu ML.

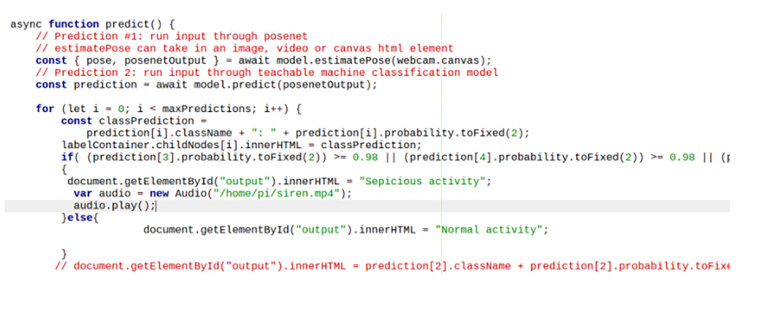

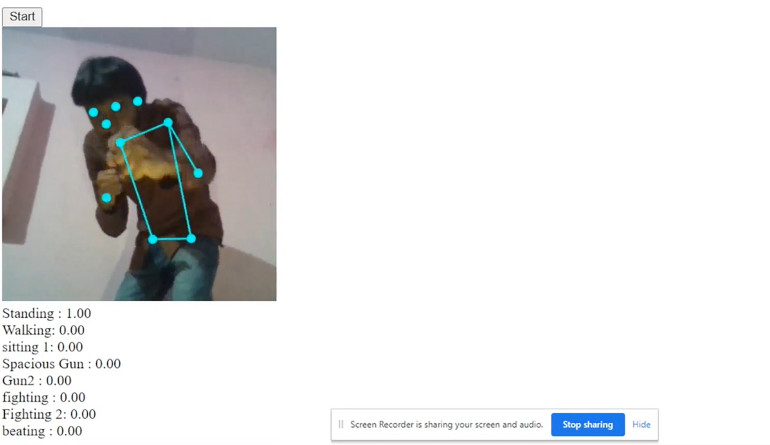

Zaimportuj model ML, który został wcześniej przesłany do chmury. Następnie sprawdź, czy działania takie jak bicie, strzelanie z pistoletu, posiadanie broni itp. są wykrywane przez ten model podczas przetwarzania wideo. Model podaje prawdopodobieństwo wystąpienia danej aktywności w zakresie od 0,00 do 1,00. Tak więc, używając warunku if, jeśli wartość wyjściowa jest większa niż 0,98, oznacza to, że osoba celuje z broni lub walczy. W tym momencie uruchamiany jest alarm, aby ostrzec ludzi w sąsiednim obszarze.

Testowanie

Zapisz kod JavaScript jako plik .html i otwórz go w dowolnej przeglądarce z włączoną obsługą JavaScript. Kliknij na przycisk start i wykonaj podejrzaną czynność przed kamerą. Model ML spróbuje ją rozpoznać i jeśli uzna za nietypową, wyda alert. Można również dodać funkcje automatycznego dzwonienia lub powiadamiania policji.