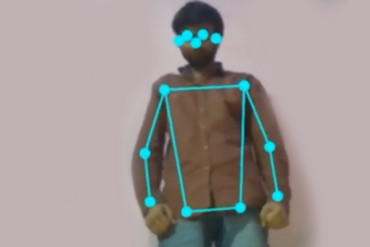

W tym artykule opisywany jest projekt, który może czytać tekst przy użyciu OCR i wizji komputerowej. Kamera zamontowana z przodu szkła do OCR i wizji komputerowej pozwoli czytać osobom niedowidzącym. W tej wersji potrzebna będzie również para gogli.

Przygotowanie

Po pierwsze, musimy zainstalować niektóre z wymaganych modułów i bibliotek dla projektu. Ponieważ inteligentne szkło jest oparte na przetwarzaniu wideo w czasie rzeczywistym, za pomocą OCR możemy wyodrębnić tekst ze stron, które mogą zawierać obrazy. Tutaj potrzebny jest moduł, który może przechwytywać obrazy z kamery. Używając modułu syntezy mowy, tekst w tych przechwyconych obrazach może być przekształcony na mowę.

Po pierwsze, musimy zainstalować następujące biblioteki:

- OpenCV

- PyTesseract

- eSpeak

Aby je zainstalować, użyj poniższych poleceń:

sudo apt-get install espeak

sudo apt-get install espeak python-espeak

sudo pip3 install opencv2Kodowanie

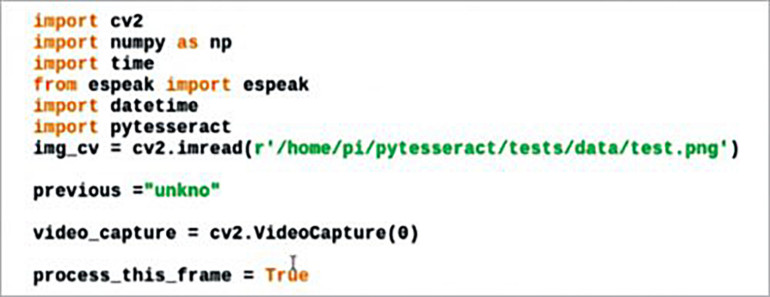

Zaimportuj wymagane biblioteki do kodu źródłowego, a następnie ustaw ścieżkę, w której mają być zapisywane klatki wideo do ekstrakcji tekstu.

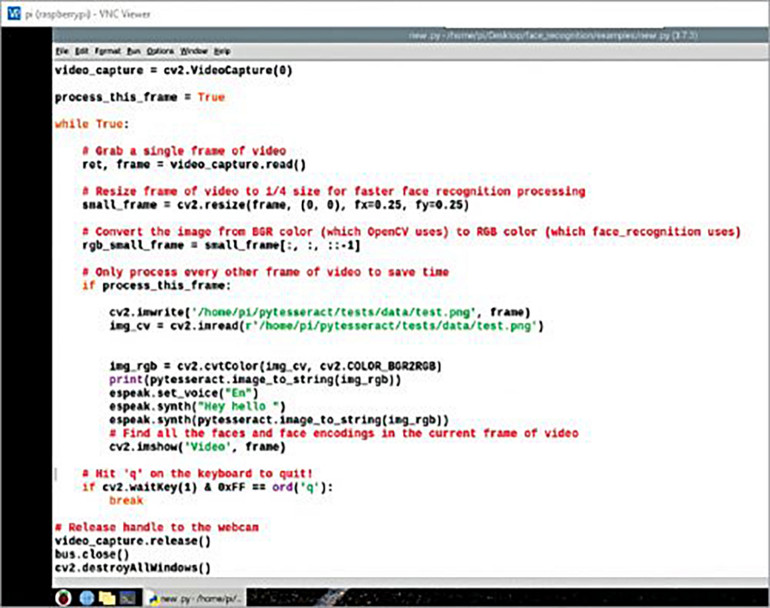

W kodzie utwórz pętlę while, która będzie przechwytywać obraz z kamery w czasie rzeczywistym. Używając cv2, przekonwertuj obraz do RGB i zapisz go we wcześniej ustawionej ścieżce. Następnie wywołaj PyTesseract, który otworzy zapisaną ramkę wideo w celu przetworzenia obrazu i wyodrębnienia z niego tekstu. Używając eSpeak, syntezator mowy przekonwertuje cały tekst na dźwięk i odczyta go.

Uwaga: Aby uzyskać wyraźny głos, który nie brzmi jak robot, można skorzystać z płatnych lub innych usług text-to-speech, takich jak gtts, watson speech itp.

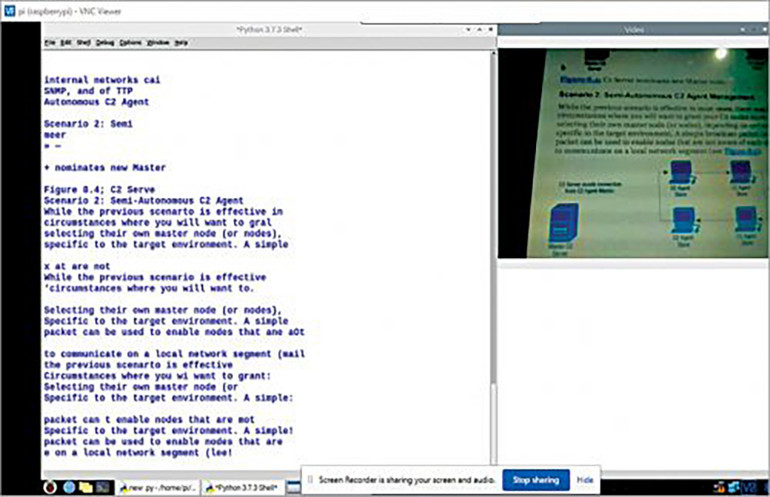

Testowanie

Zamocuj kamerę na okularach i uruchom kod. Po położeniu książki przed kamerą i odczekaniu kilku minut bez żadnego ruchu, rozpocznie się automatyczne czytanie książki. Aby ją usłyszeć, podłącz słuchawki do gniazda słuchawkowego TRRS w Raspberry Pi lub dowolny głośnik ze wzmacniaczem. Można też podłączyć dowolne słuchawki Bluetooth.